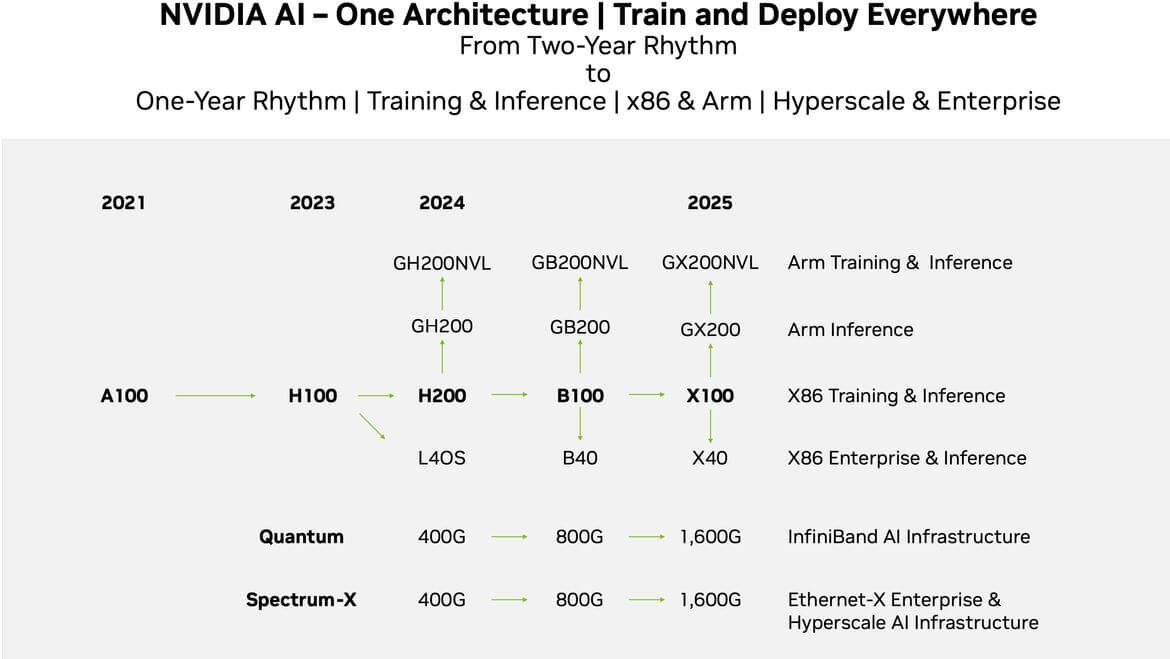

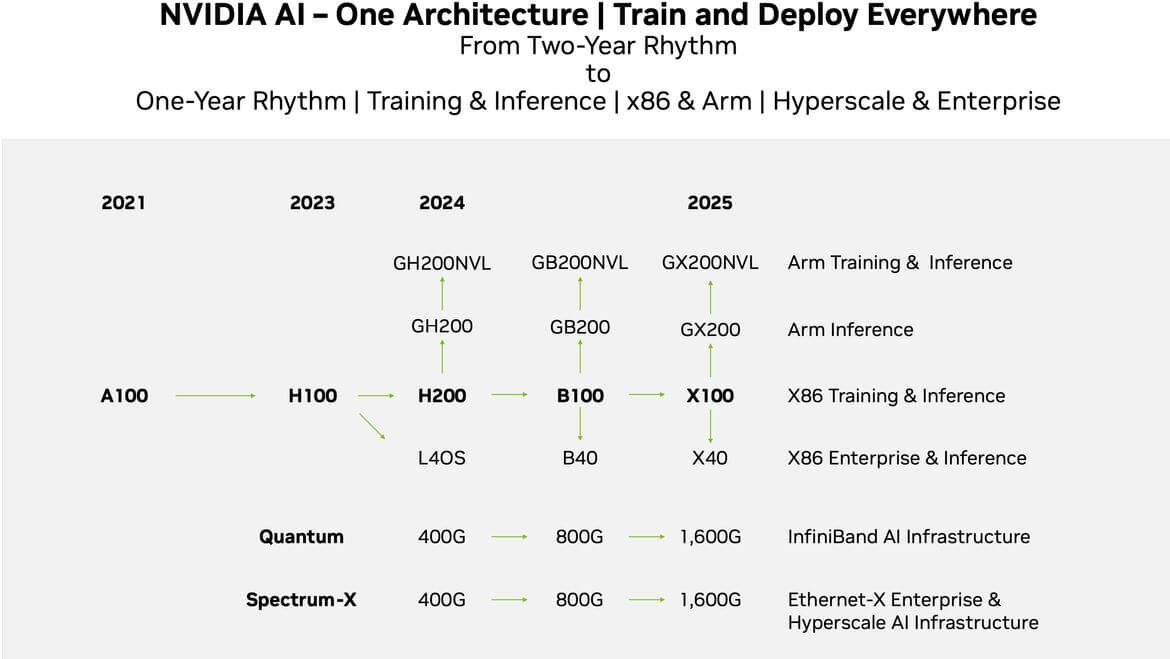

Nvidia در تلاش برای حفظ رهبری خود در زمینه هوش مصنوعی (AI) و سختافزار محاسباتی با کارایی بالا (HPC)، قصد دارد توسعه معماریهای جدید GPU را تسریع بخشد و اساساً طبق گفته خود به سرعت یک ساله خود برای معرفی محصولات بازگردد. نقشه راه برای سرمایه گذاران منتشر شده و توسط SemiAnalysis توضیح داده شده است.در نتیجه، بلک ول انویدیا در سال 2024 عرضه خواهد شد و در سال 2025 با معماری جدیدی جایگزین خواهد شد. اما قبل از ورود Blackwell در سال آینده (احتمالاً در نیمه دوم سال آینده میلادی)، Nvidia قرار است چندین محصول جدید را بر اساس معماری

Hopper خود عرضه کند.این عرضه شامل محصول H200 است، که ممکن است چرخشی مجدد از H100 باشد که برای بازدهی بیشتر یا فقط عملکرد بالاتر، ساخته شده است، و همچنین پردازنده گرافیکی مبتنی بر GH200NVL، که به آموزش و استنتاج در مدلهای زبان بزرگ با CPU مبتنی بر Arm و Hopper- میپردازد. اینها قرار است زودتر از اینها بیایند.

در مورد خانواده بلک ول که قرار است در سال 2024 عرضه شود، به نظر می رسد انویدیا محصول B100 را برای محاسبات هوش مصنوعی و HPC روی پلتفرم های x86 آماده می کند که جایگزین H100 خواهد شد. علاوه بر این، این شرکت GB200 را آماده میکند، که احتمالاً ماژول Grace Hopper دارای یک Arm CPU و یک Hopper GPU است که استنتاج را هدف قرار میدهد و همچنین GB200NVL، یک راهحل مبتنی بر Arm برای آموزش و استنتاج LLM. همچنین، این شرکت در حال برنامه ریزی محصول B40 است که احتمالاً یک راه حل مبتنی بر GPU مشتری برای استنتاج هوش مصنوعی است. در سال 2025، بلک ول با معماری با حرف X که احتمالاً در حال حاضر در یک مکان نگهدار است، جایگزین خواهد شد. به هر حال، انویدیا X100 را برای آموزش و استنتاج AI x86 و همچنین HPC، GX200 را برای استنتاج Arm (Grace CPU + X GPU) و GX200NVL را برای آموزش و استنتاج LLM مبتنی بر Arm آماده میکند. علاوه بر این، محصول X40 - احتمالاً مبتنی بر یک راه حل متکی بر GPU مشتری - برای کاهش هزینه وجود خواهد داشت. در حال حاضر انویدیا در بازار پردازنده های گرافیکی هوش مصنوعی پیشتاز است، اما AWS، گوگل، مایکروسافت و همچنین بازیکنان سنتی هوش مصنوعی و HPC مانند AMD و Nvidia همگی در حال آماده سازی پردازنده های نسل جدید خود برای آموزش و استنتاج هستند، به همین دلیل است که Nvidia طبق گزارش ها برنامه های خود را برای محصولات مبتنی بر B100 و X100 سرعت بخشیده است. انویدیا برای استحکام بیشتر موقعیتهای خود، ظرفیت TSMC و حافظه HBM را از هر سه سازنده پیشخرید کرده است. علاوه بر این، انویدیا برنامه هایی فشرده ای برای محبوب کردن سرورهای HGX و MGX خود در میان کاربران نهایی، به ویژه در بخش هوش مصنوعی سازمانی دارد.

در مورد خانواده بلک ول که قرار است در سال 2024 عرضه شود، به نظر می رسد انویدیا محصول B100 را برای محاسبات هوش مصنوعی و HPC روی پلتفرم های x86 آماده می کند که جایگزین H100 خواهد شد. علاوه بر این، این شرکت GB200 را آماده میکند، که احتمالاً ماژول Grace Hopper دارای یک Arm CPU و یک Hopper GPU است که استنتاج را هدف قرار میدهد و همچنین GB200NVL، یک راهحل مبتنی بر Arm برای آموزش و استنتاج LLM. همچنین، این شرکت در حال برنامه ریزی محصول B40 است که احتمالاً یک راه حل مبتنی بر GPU مشتری برای استنتاج هوش مصنوعی است. در سال 2025، بلک ول با معماری با حرف X که احتمالاً در حال حاضر در یک مکان نگهدار است، جایگزین خواهد شد. به هر حال، انویدیا X100 را برای آموزش و استنتاج AI x86 و همچنین HPC، GX200 را برای استنتاج Arm (Grace CPU + X GPU) و GX200NVL را برای آموزش و استنتاج LLM مبتنی بر Arm آماده میکند. علاوه بر این، محصول X40 - احتمالاً مبتنی بر یک راه حل متکی بر GPU مشتری - برای کاهش هزینه وجود خواهد داشت. در حال حاضر انویدیا در بازار پردازنده های گرافیکی هوش مصنوعی پیشتاز است، اما AWS، گوگل، مایکروسافت و همچنین بازیکنان سنتی هوش مصنوعی و HPC مانند AMD و Nvidia همگی در حال آماده سازی پردازنده های نسل جدید خود برای آموزش و استنتاج هستند، به همین دلیل است که Nvidia طبق گزارش ها برنامه های خود را برای محصولات مبتنی بر B100 و X100 سرعت بخشیده است. انویدیا برای استحکام بیشتر موقعیتهای خود، ظرفیت TSMC و حافظه HBM را از هر سه سازنده پیشخرید کرده است. علاوه بر این، انویدیا برنامه هایی فشرده ای برای محبوب کردن سرورهای HGX و MGX خود در میان کاربران نهایی، به ویژه در بخش هوش مصنوعی سازمانی دارد.

در مورد خانواده بلک ول که قرار است در سال 2024 عرضه شود، به نظر می رسد انویدیا محصول B100 را برای محاسبات هوش مصنوعی و HPC روی پلتفرم های x86 آماده می کند که جایگزین H100 خواهد شد. علاوه بر این، این شرکت GB200 را آماده میکند، که احتمالاً ماژول Grace Hopper دارای یک Arm CPU و یک Hopper GPU است که استنتاج را هدف قرار میدهد و همچنین GB200NVL، یک راهحل مبتنی بر Arm برای آموزش و استنتاج LLM. همچنین، این شرکت در حال برنامه ریزی محصول B40 است که احتمالاً یک راه حل مبتنی بر GPU مشتری برای استنتاج هوش مصنوعی است. در سال 2025، بلک ول با معماری با حرف X که احتمالاً در حال حاضر در یک مکان نگهدار است، جایگزین خواهد شد. به هر حال، انویدیا X100 را برای آموزش و استنتاج AI x86 و همچنین HPC، GX200 را برای استنتاج Arm (Grace CPU + X GPU) و GX200NVL را برای آموزش و استنتاج LLM مبتنی بر Arm آماده میکند. علاوه بر این، محصول X40 - احتمالاً مبتنی بر یک راه حل متکی بر GPU مشتری - برای کاهش هزینه وجود خواهد داشت. در حال حاضر انویدیا در بازار پردازنده های گرافیکی هوش مصنوعی پیشتاز است، اما AWS، گوگل، مایکروسافت و همچنین بازیکنان سنتی هوش مصنوعی و HPC مانند AMD و Nvidia همگی در حال آماده سازی پردازنده های نسل جدید خود برای آموزش و استنتاج هستند، به همین دلیل است که Nvidia طبق گزارش ها برنامه های خود را برای محصولات مبتنی بر B100 و X100 سرعت بخشیده است. انویدیا برای استحکام بیشتر موقعیتهای خود، ظرفیت TSMC و حافظه HBM را از هر سه سازنده پیشخرید کرده است. علاوه بر این، انویدیا برنامه هایی فشرده ای برای محبوب کردن سرورهای HGX و MGX خود در میان کاربران نهایی، به ویژه در بخش هوش مصنوعی سازمانی دارد.

مجله صفرویک

مجله صفرویک