لیست مطالب

عصر هوش مصنوعی مولد نه تنها شیوه کار ما، بلکه روشهای تقلب و کلاهبرداری سازمانی را نیز متحول کرده است. در حالی که کسبوکارها برای اتوماسیون فرایندهای مالی خود به هوش مصنوعی روی آوردهاند، کارمندان نیز از همین فناوری برای ارتکاب یکی از قدیمی ترین انواع تقلب سازمانی، یعنی جعل رسید های هزینه، با دقتی بیسابقه استفاده می کنند. اکنون، پلتفرمهای پیشرو مدیریت هزینه هشدار میدهند که عرضه مدلهای تصویرساز جدید مانند GPT-4o و ابزارهای مشابه، باعث افزایش چشمگیر و نگران کننده رسیدهای ساختهشده با هوش مصنوعی شده است.

سونامی جعل هوش مصنوعی: آمارها چه می گویند؟

مدلهای تولید تصویر، که اکنون بهصورت آسان و اغلب رایگان در دسترس عموم قرار دارند، نیاز به مهارتهای ویرایش حرفهای یا پرداخت هزینه به جاعلین آنلاین را از بین بردهاند. یک دستور متنی ساده به چتبات کافی است تا در عرض چند ثانیه، یک رسید جعلی با جزئیات خیرهکننده تولید شود.

داده های شرکت های مدیریت هزینه، زنگ خطر را به صدا درآورده اند:

- AppZen: این شرکت نرمافزاری اعلام کرد که در سپتامبر گذشته، حدود ۱۴ درصد از کل اسناد تقلبی ارائهشده، رسیدهای جعلی ساختهشده با هوش مصنوعی بودند؛ رقمی که یک سال قبل تقریباً صفر بود.

- Ramp: این گروه فینتک گزارش داد که نرمافزار جدیدش توانسته است ظرف ۹۰ روز، صورتحسابهای تقلبی به ارزش بیش از یک میلیون دلار را شناسایی کند.

- Medius: طبق نظرسنجی این پلتفرم از متخصصان مالی در آمریکا و بریتانیا، حدود ۳۰ درصد شاهد افزایش جعل رسید پس از عرضه GPT-4o بودهاند.

کریستوفر ژونو، معاون ارشد SAP Concur (یکی از بزرگ ترین پلتفرم های مدیریت هزینه دنیا)، با اشاره به دقت و کیفیت این اسناد، میگوید: «این رسیدها آن قدر واقعی شده اند که به مشتریان مان می گوییم به چشم های خود اعتماد نکنید.»

سطح جدید واقع گرایی: جزئیاتی که انسان را فریب می دهد

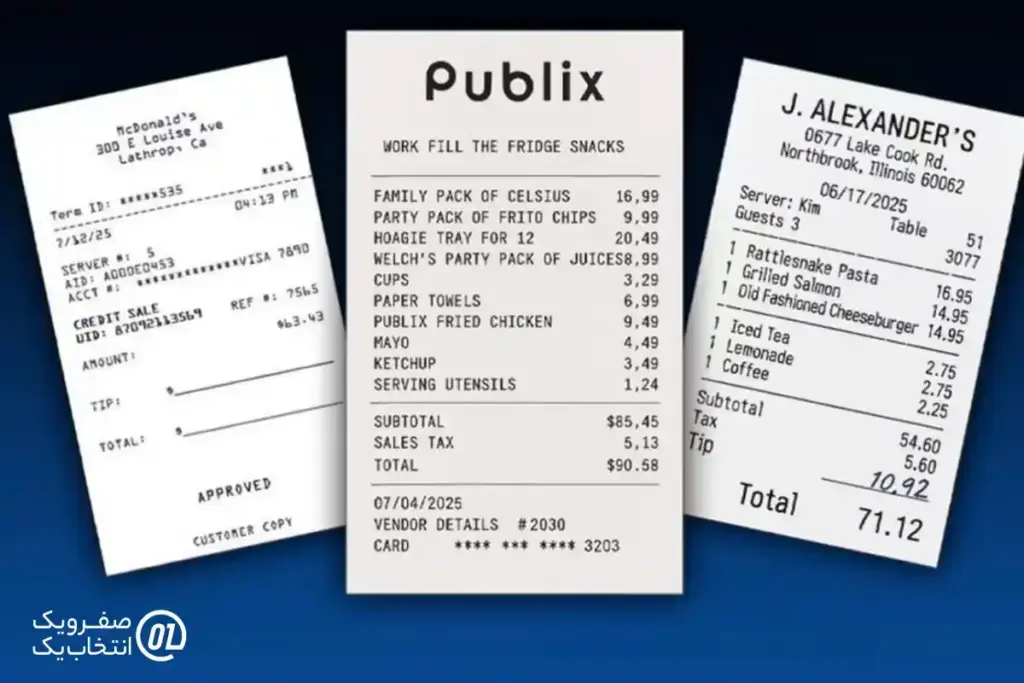

رسیدهای جعلی تولیدشده توسط هوش مصنوعی دیگر شبیه نسخههای ساده و دستکاریشده نیستند. نسخههایی که به Financial Times توسط پلتفرمهای مدیریت هزینه نشان داده شد، سطح بالایی از واقعیت را به نمایش میگذارند:

- جزئیات فیزیکی: تصاویر شامل چینخوردگیهای طبیعی کاغذ و سایهزنیهای واقعگرایانه هستند.

- دقت محتوایی: ریزهکاریها در اقلام منو کاملاً مشابه منوی واقعی بوده و حتی امضا نیز در تصویر وجود دارد.

سباستین مارشون، مدیرعامل Rydoo، تأکید میکند: «این تهدید آینده نیست؛ همین حالا رخ داده است. اگرچه فعلاً درصد اندکی از کل تقلبها را تشکیل می دهند، اما این رقم قطعاً افزایش خواهد یافت.» این سطح از واقعگرایی بدان معناست که دیگر نمیتوان صرفاً به بررسیهای چشمی و انسانی برای تشخیص تقلب اتکا کرد.

مسابقه تسلیحاتی هوش مصنوعی: تشخیص در برابر جعل

در واکنش به این تهدید جدید، شرکتها نیز برای تشخیص رسیدهای جعلی به هوش مصنوعی روی آوردهاند. با این حال، حتی ابزارهای تشخیص نیز با چالشهایی روبرو هستند:

- دور زدن متادیتا: پلتفرم هایی مانند OpenAI ادعا می کنند تصاویرشان دارای متادیتایی هستند که نشان میدهد با ChatGPT ساخته شده اند. اما جاعلین به سادگی می توانند با عکس گرفتن یا اسکرین شات از تصویر جعلی، این اطلاعات را حذف کنند.

- فراتر از پیکسل ها: برای مقابله با این ترفند، نرمافزارهای تشخیص اکنون مجبورند فراتر از خود تصویر رفته و اطلاعات زمینه ای و متنی دیگری را بررسی کنند؛ مانند تکرار نام سرورها، زمان های ثبتشده و داده های فراگیر سفر کارمند.

کالوین لی، مدیر ارشد Ramp، می افزاید: «این فناوری میتواند همه چیز را با دقتی متمرکز بررسی کند که انسانها، بعد از مدتی، ممکن است نکاتی از دستشان در برود؛ چون بالاخره انسان هستند.»

هشدارهای سازمانی و پیامدهای اخلاقی

این تغییر تکنولوژیک، تقلب را به یک «مسئله مهم سازمانی» تبدیل کرده است. میسن وایدر، مدیر پژوهش انجمن ممتحنان معتمد تقلب، هشدار میدهد: «امکان ورود برای افراد کاملاً آزاد است. دیگر به هیچ مهارت فنی یا تخصصی نیاز ندارید؛ مثل پنج سال قبل که باید با فتوشاپ کار می کردید.»

پژوهش شرکت SAP در ماه ژوئیه نشان داد که حدود ۷۰ درصد مدیران مالی اعتقاد دارند کارکنان شان برای تقلب در هزینه از هوش مصنوعی بهره می برند و ۱۰ درصد نیز مطمئن بودند که این اتفاق در شرکت آن ها رخ داده است. در نهایت، در عصر هوش مصنوعی، نبرد میان سیستم های مالی مبتنی بر AI و تقلب های هوشمندانه کارمندان، به یکی از بزرگترین چالش های حکمرانی شرکتی و اخلاق کاری تبدیل شده است.

مجله صفرویک

مجله صفرویک