لیست مطالب

در دنیای پرشتاب هوش مصنوعی، به خصوص در حوزه مدل های زبانی بزرگ (LLM)، رقابت برای دستیابی به مدل هایی با عملکرد بهتر، سریع تر و کم مصرف تر همواره ادامه دارد. در این میان، DeepSeek R2 به عنوان یکی از پیشگامان، با بهره گیری از معماری (MoE (Mixture-of-Experts، چشم انداز جدیدی از کارایی و مقیاس پذیری را به نمایش گذاشته است. این مقاله به بررسی جایگاه DeepSeek R2 و اهمیت معماری MoE در آینده هوش مصنوعی می پردازد.

معماری MoE چیست؟ چرا مهم است؟

قبل از ورود به DeepSeek R2، لازم است با مفهوم معماری MoE آشنا شویم. در مدل های سنتی هوش مصنوعی، تمام پارامترهای مدل در هر مرحله از پردازش داده، فعال می شوند. این رویکرد، به خصوص در مدل های بسیار بزرگ با میلیاردها پارامتر، منجر به مصرف بالای منابع محاسباتی (GPU) و کندی در پاسخگویی می شود.

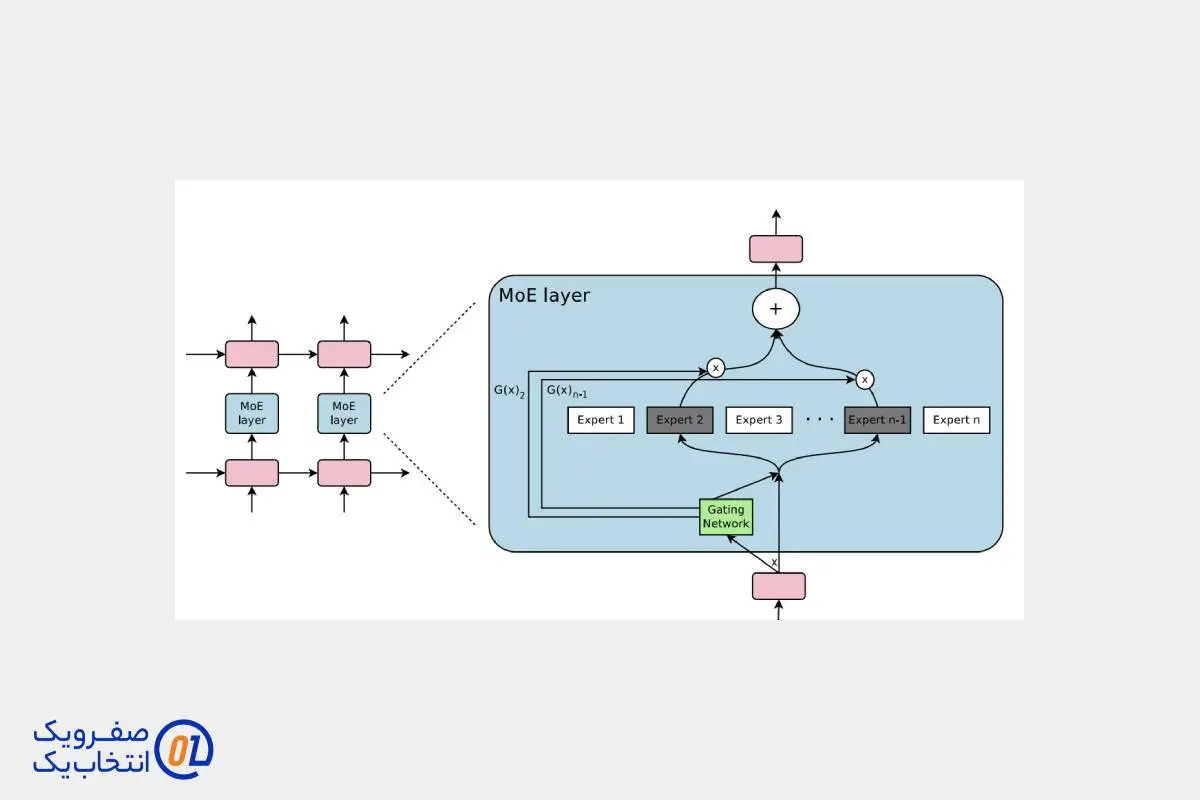

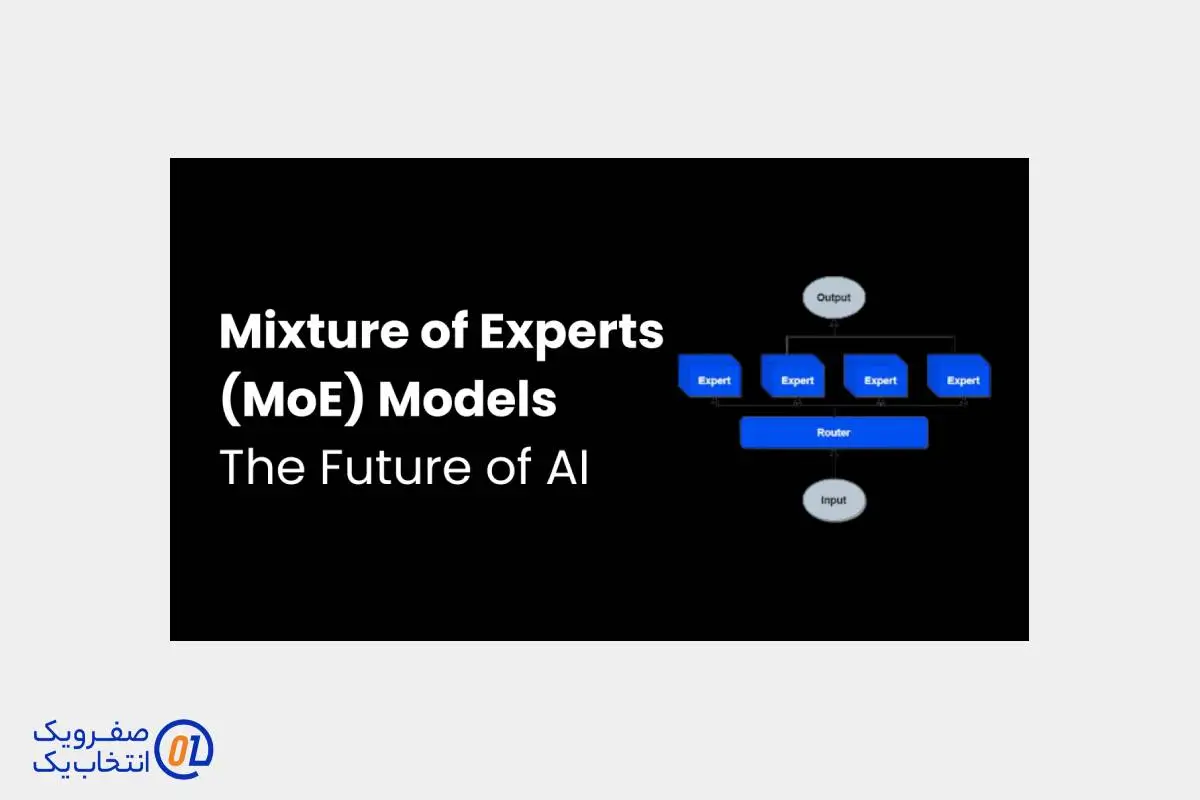

(MoE (Mixture-of-Experts یا "ترکیبی از متخصصان" یک رویکرد معماری نوین است که این مشکل را حل می کند. در این معماری:

- متخصصان (Experts): مدل به چندین "متخصص" کوچکتر تقسیم می شود که هر یک بخشی از دانش کل مدل را در خود جای داده اند. این متخصصان می توانند شبکه های عصبی کوچک تر باشند.

- گیت (Gate/Router): یک شبکه عصبی کوچک تر به نام "گیت" یا "روتر" وجود دارد که ورودی (مثلاً یک پرامپت متنی) را دریافت کرده و تصمیم می گیرد که کدام یک از متخصصان برای پردازش آن ورودی مناسب تر هستند. تنها تعداد کمی از این متخصصان (معمولاً 1 تا 3) برای هر ورودی فعال می شوند.

چرا MoE مهم است؟

اهمیت MoE در قابلیت آن برای ساخت مدل های بسیار بزرگ (از نظر تعداد کل پارامترها) است، در حالی که در هر زمان تنها بخش کوچکی از آن ها فعال هستند. این ویژگی منجر به مزایای چشمگیری می شود:

- کارایی بالاتر (Efficiency): از آنجایی که تنها زیر مجموعه ای از پارامترها درگیر پردازش می شوند، مصرف منابع محاسباتی و انرژی به طور قابل توجهی کاهش می یابد.

- سرعت بالاتر (Speed): زمان لازم برای محاسبات کمتر می شود و مدل ها می توانند سریع تر پاسخ دهند.

- مقیاس پذیری بهتر (Scalability): می توان مدل هایی با تعداد پارامترهای بسیار بیشتر ساخت بدون اینکه هزینه محاسباتی به صورت خطی افزایش یابد. این امکان توسعه مدل های هوش مصنوعی با قابلیت های خیره کننده ای را فراهم می آورد.

- یادگیری تخصصی (Specialized Learning): هر متخصص می تواند در حوزه خاصی از دانش یا نوع خاصی از وظایف مهارت پیدا کند، که به بهبود عملکرد کلی مدل کمک می کند.

DeepSeek R2: پیشگام در استفاده از MoE

DeepSeek R2 یک مدل زبانی بزرگ از شرکت DeepSeek است که از معماری MoE بهره می برد. این مدل در اندازه های مختلفی عرضه شده، اما نقطه قوت اصلی آن در نسخه های بزرگتر با معماری MoE نمایان می شود. این مدل توانسته در بنچمارک های مختلف، عملکردی رقابتی یا حتی بهتر از مدل های بزرگتر و متراکم تر (Dense Models) از خود نشان دهد، در حالی که به منابع محاسباتی کمتری نیاز دارد.

ویژگی های کلیدی DeepSeek R2 (با تاکید بر MoE):

- پارامترهای بالا، فعالسازی کم: نسخه های MoE DeepSeek R2 ممکن است میلیاردها پارامتر داشته باشند، اما در هر زمان تنها کسری از آن ها فعال می شوند. به عنوان مثال، در یک مدل 236 میلیارد پارامتری، تنها 13 میلیارد پارامتر در هر فوروارد پس (Forward Pass) فعال می شوند.

- عملکرد رقابتی: با وجود فعالسازی کمتر پارامترها، DeepSeek R2 نشان داده است که می تواند در وظایفی مانند تولید متن، کدنویسی، استدلال و درک زبان، به نتایج بسیار خوبی دست یابد.

- صرفه جویی در منابع: این مدل می تواند با همان منابع محاسباتی که برای آموزش یا اجرای یک مدل متراکم بسیار کوچکتر لازم است، به سطوح عملکرد بالاتری دست پیدا کند. این امر باعث می شود DeepSeek R2 و سایر مدل های MoE برای توسعه دهندگان و شرکت هایی که به دنبال بهره وری بالا هستند، جذاب باشند.

- نوآوری در پژوهش: DeepSeek R2 نشان دهنده یک جهش مهم در نحوه طراحی و مقیاس بندی مدل های زبانی بزرگ است و راه را برای تحقیقات و توسعه بیشتر در زمینه معماری های MoE هموار می کند.

MoE نقشی محوری در آینده هوش مصنوعی

با ظهور و موفقیت مدل هایی مانند DeepSeek R2 و دیگر مدل های مبتنی بر MoE (مانند Mixtral 8x7B)، به نظر می رسد معماری MoE نقشی محوری در آینده هوش مصنوعی ایفا خواهد کرد.

- پاسخ به محدودیت های منابع: با توجه به نیاز روزافزون به مدل های بزرگ تر و قدرتمندتر، منابع محاسباتی (به ویژه GPU) به یک گلوگاه تبدیل شده اند. MoE با افزایش بهره وری از این منابع، امکان ادامه روند رشد اندازه و قابلیت های مدل ها را فراهم می کند.

- دموکراتیزه کردن هوش مصنوعی پیشرفته: اگر مدل های هوش مصنوعی پیشرفته، از نظر محاسباتی کارآمدتر شوند، دسترسی به آنها برای شرکت های کوچک تر، استارتاپ ها و حتی توسعه دهندگان فردی آسان تر خواهد شد. این می تواند به نوآوری و رقابت بیشتر در صنعت هوش مصنوعی منجر شود.

- تخصیص منابع هوشمند: در آینده، می توان انتظار داشت که معماری های MoE پیچیده تر شوند و بتوانند منابع محاسباتی را به صورت هوشمندانه تری بر اساس پیچیدگی وظیفه یا نوع ورودی تخصیص دهند.

- کاهش هزینه ها: هم برای آموزش و هم برای استنتاج (inference) مدل ها، MoE می تواند به طور قابل توجهی هزینه ها را کاهش دهد، که این امر برای کاربردهای تجاری بسیار مهم است.

چالش ها و چشم انداز آینده

البته، معماری MoE نیز چالش های خاص خود را دارد:

- پیچیدگی پیاده سازی: طراحی و آموزش مدل های MoE پیچیده تر از مدل های متراکم است.

- مدیریت متخصصان: اطمینان از اینکه هر متخصص به درستی در حوزه خود یادگیری می کند و "گیت" به درستی متخصصان را انتخاب می کند، می تواند چالش برانگیز باشد.

- چگالی اطلاعات: با اینکه تعداد پارامترهای کلی بالاست، اما از آنجایی که در هر بار پردازش، تنها بخشی از مدل فعال می شود، ممکن است در برخی موارد، "تراکم" دانش مدل کمتر از یک مدل متراکم هم اندازه باشد.

با این حال، با توجه به پژوهش ها و پیشرفت های مداوم، انتظار می رود که این چالش ها برطرف شده و معماری MoE به استاندارد جدیدی برای ساخت مدل های زبانی بزرگ و سایر مدل های هوش مصنوعی با کارایی بالا تبدیل شود. DeepSeek R2 نمونه ای درخشان از پتانسیل این معماری است و نشان می دهد که چگونه می توان با رویکردهای نوآورانه، آینده کارایی و قابلیت های هوش مصنوعی را شکل داد.

آیا مایلید در مورد کاربردهای خاص DeepSeek R2 یا جزئیات فنی معماری MoE بیشتر بدانید؟

مجله صفرویک

مجله صفرویک