لیست مطالب

در دنیای امروز که مدلهای زبان بزرگ (LLM) مانند ChatGPT و Claude با سرعتی شگفتانگیز در حال پیشرفت هستند، یک پرسش اساسی ذهن همگان را به خود مشغول کرده است: چگونه میتوانیم اطمینان حاصل کنیم که این سیستمهای هوشمند، همواره در راستای منافع بشریت عمل کرده و از تولید محتوای مضر، جانبدارانه یا خطرناک خودداری کنند؟ این چالش که به "مشکل هم راستاسازی" (Alignment Problem) معروف است، یکی از بزرگ ترین موانع در مسیر توسعه مسئولانه هوش مصنوعی به شمار می رود.

شرکت تحقیقاتی Anthropic، که توسط کارمندان سابق OpenAI تأسیس شده، با ارائه یک رویکرد نوآورانه و قدرتمند به نام هوش مصنوعی قانون اساسی (Constitutional AI)، گامی بلند در جهت حل این مشکل برداشته است. این روش، مدلی برای آموزش سیستمهای هوش مصنوعی، بهویژه مدلهای زبانی، ارائه میدهد که بدون نیاز به بازخوردهای انسانی گسترده، بتوانند رفتارهای مضر را تشخیص داده و خود را با مجموعهای از اصول اخلاقی همراستا کنند. در این مقاله، به بررسی عمیق این مفهوم، نحوه عملکرد، اصول بنیادین و تأثیر آن بر آینده هوش مصنوعی خواهیم پرداخت.

هوش مصنوعی قانون اساسی چیست؟

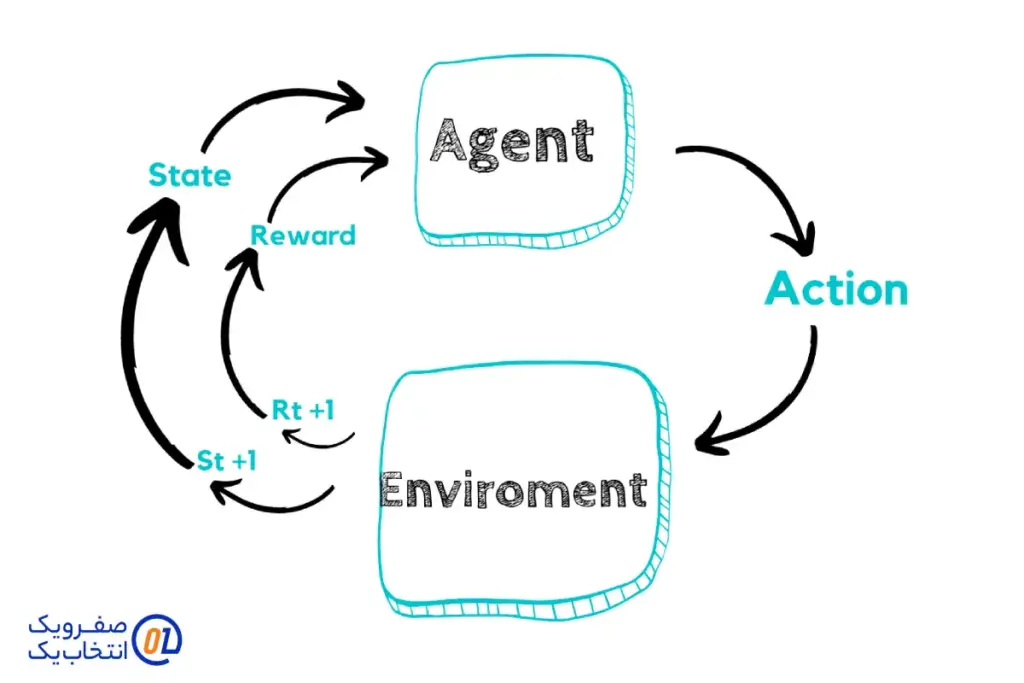

به زبان ساده، هوش مصنوعی قانون اساسی یک روش دو مرحلهای برای آموزش مدلهای هوش مصنوعی است تا بتوانند مفید، صادق و بیخطر باشند. ایده اصلی این است که به جای اینکه انسانها به طور مداوم به AI بگویند چه چیزی خوب یا بد است (روشی که در یادگیری تقویتی با بازخورد انسانی یا RLHF استفاده میشود)، یک "قانون اساسی" یا مجموعهای از اصول و ارزشها به AI داده میشود. سپس، هوش مصنوعی یاد می گیرد که پاسخهای خود را بر اساس این قانون اساسی ارزیابی، نقد و اصلاح کند.

این رویکرد، وابستگی فرآیند آموزش را به حجم عظیمی از دادههای برچسبگذاری شده توسط انسان که اغلب مستعد سوگیریهای فردی و فرهنگی هستند، به شدت کاهش میدهد. در واقع، AI یاد میگیرد که خودش پلیس اخلاقی خودش باشد و بر اساس یک چارچوب ارزشی مشخص عمل کند.

فرآیند دو مرحله ای آموزش در هوش مصنوعی قانون اساسی

فرآیند آموزش یک مدل با استفاده از رویکرد (Constitutional AI (CAI شامل دو فاز اصلی است:

فاز اول: یادگیری تحت نظارت (Supervised Learning)

- شروع با یک مدل پایه: ابتدا یک مدل زبان بزرگ که فقط برای مفید بودن (و نه بیخطر بودن) آموزش دیده است، انتخاب میشود.

- تولید پاسخ و نقد خود: این مدل در معرض پرامپتها (دستورات) مختلفی قرار میگیرد، از جمله پرامپتهایی که میتوانند منجر به پاسخهای مضر یا نامناسب شوند. مدل، پاسخی برای این پرامپتها تولید میکند.

- نقد مبتنی بر قانون اساسی: در مرحله بعد، از خود مدل خواسته میشود تا پاسخی را که تولید کرده، بر اساس یک اصل تصادفی از "قانون اساسی" نقد کند و نقاط ضعف آن را مشخص نماید.

- بازنویسی پاسخ: سپس، مدل بر اساس نقدی که انجام داده، پاسخ اولیه خود را بازنویسی میکند تا با اصل مورد نظر از قانون اساسی کاملاً همراستا باشد.

- ایجاد دیتاست جدید: این فرآیند (تولید، نقد، بازنویسی) بارها و بارها تکرار میشود تا یک مجموعه داده بزرگ از پاسخهای اصلاح شده و همراستا با اصول اخلاقی ایجاد گردد.

- تنظیم دقیق (Fine-Tuning): در نهایت، مدل پایه اولیه با استفاده از این مجموعه داده جدید و اصلاح شده، مجدداً آموزش داده میشود (Fine-Tuned). نتیجه این فاز، مدلی است که درک بهتری از نحوه تولید پاسخهای بیخطر و اخلاقی دارد.

فاز دوم: یادگیری تقویتی (Reinforcement Learning)

این مرحله که به آن یادگیری تقویتی از بازخورد هوش مصنوعی (RLAIF) نیز گفته میشود، جایگزین روش سنتی RLHF میگردد.

- تولید جفت پاسخ: مدلی که در فاز اول آموزش دیده است، برای یک پرامپت مشخص، دو پاسخ متفاوت تولید میکند.

- مقایسه توسط هوش مصنوعی: یک مدل هوش مصنوعی دیگر (که به عنوان مدل ترجیحی عمل میکند)، این دو پاسخ را دریافت کرده و بر اساس قانون اساسی، مشخص میکند کدام یک از آنها بهتر، ایمنتر و اخلاقیتر است.

- آموزش مدل ترجیحی: این مقایسهها یک دیتاست بزرگ از ترجیحات هوش مصنوعی ایجاد میکند. این دیتاست برای آموزش یک "مدل ترجیحی" (Preference Model) به کار میرود که یاد میگیرد کدام نوع پاسخها با قانون اساسی سازگارتر هستند.

- یادگیری تقویتی نهایی: در گام آخر، مدل تنظیم شده از فاز اول، با استفاده از یادگیری تقویتی در مقابل این مدل ترجیحی آموزش میبیند. این فرآیند باعث میشود که مدل نهایی به طور کامل با اصول قانون اساسی همراستا شده و توانایی بالایی در تولید پاسخهای مفید و بیخطر پیدا کند.

"قانون اساسی" از کجا می آید؟

شاید مهمترین سؤال این باشد که این اصول و قوانین توسط چه کسی و بر چه اساسی تدوین میشوند. "قانون اساسی" مورد استفاده توسط Anthropic یک سند واحد و ثابت نیست، بلکه مجموعهای از اصول الهام گرفته شده از منابع مختلف است، از جمله:

- اعلامیه جهانی حقوق بشر سازمان ملل: برای اطمینان از رعایت اصول بنیادین انسانی.

- شرایط خدمات شرکتهای فناوری معتبر: مانند اپل، که شامل قوانینی برای جلوگیری از سوءاستفاده از پلتفرم است.

- تحقیقات پیشرو در زمینه ایمنی هوش مصنوعی: شامل اصول پیشنهادی توسط سایر آزمایشگاههای تحقیقاتی مانند DeepMind.

- اصول جهانی پذیرفته شده: مانند اصل عدم تناقض و تشویق به تفکر منطقی.

این رویکرد ترکیبی تضمین میکند که قانون اساسی تا حد امکان جامع، بیطرفانه و مبتنی بر ارزشهای جهانی باشد.

مزایا و اهمیت هوش مصنوعی قانون اساسی

استفاده از این روش مزایای قابل توجهی نسبت به روشهای سنتی همراستاسازی دارد:

- شفافیت بیشتر: برخلاف مدلهای "جعبه سیاه" که دلیل تصمیماتشان مشخص نیست، در رویکرد CAI، اصول حاکم بر رفتار مدل کاملاً شفاف و قابل بررسی هستند.

- کاهش سوگیری انسانی: با حذف بخش بزرگی از بازخوردهای انسانی مستقیم، احتمال انتقال سوگیریهای ناخودآگاه افراد به مدل هوش مصنوعی کاهش مییابد.

- مقیاسپذیری بالا: فرآیند RLAIF بسیار مقیاسپذیرتر از RLHF است، زیرا تولید بازخورد توسط هوش مصنوعی بسیار سریعتر و ارزانتر از جمعآوری بازخورد از هزاران انسان است.

- ایمنی ذاتی: ایمنی و اخلاق به جای اینکه به عنوان یک لایه بیرونی به مدل اضافه شوند، در هسته فرآیند یادگیری آن ادغام میشوند و مدلی ذاتاً ایمنتر تولید میکنند.

چالش ها و نگاه به آینده

با وجود تمام مزایا، هوش مصنوعی قانون اساسی هنوز یک راهحل بینقص نیست. چالشهایی مانند انتخاب و تدوین اصول قانون اساسی (چه کسی تصمیم میگیرد کدام اصول وارد شوند؟)، توانایی مدل در تفسیر صحیح و دقیق این اصول، و حل تعارضات احتمالی بین اصول مختلف، همچنان موضوع بحث و تحقیق هستند.

با این حال، این رویکرد یک گام بسیار مهم و امیدوارکننده به سوی ساخت هوش مصنوعی عمومی (AGI) است که بتوانیم به آن اعتماد کنیم. توسعه و استقرار چنین مدلهای پیشرفتهای نیازمند زیرساختهای دیجیتال فوقالعاده قدرتمند، امن و پایدار است. سرورهای اختصاصی و مجازی با عملکرد بالا، پهنای باند بدون قطعی و مراکز داده امن، بستری هستند که این انقلاب فناورانه بر روی آن بنا میشود و شرکتهایی مانند صفرویک نقش کلیدی در تأمین این زیرساخت حیاتی ایفا میکنند.

در نهایت، هوش مصنوعی قانون اساسی نشان می دهد که آینده توسعه AI نه فقط در افزایش توانایی های محاسباتی، بلکه در تعریف چارچوب های اخلاقی هوشمند برای هدایت این توانایی ها نهفته است.

شرکت صفرویک پرداز

برای به ثمر رساندن ایدههای نوآورانه خود در دنیای فناوری و هوش مصنوعی، به زیرساختی قدرتمند و مطمئن نیاز دارید. شرکت صفرویک پرداز با ارائه سرورهای اختصاصی و مجازی پرسرعت، اینترنت پایدار و پشتیبانی ۲۴ ساعته، بهترین بستر را برای پروژه های شما فراهم می کند. با ما تماس بگیرید و از مشاوره تخصصی کارشناسان ما بهره مند شوید تا آینده دیجیتال خود را با اطمینان بسازید.

مجله صفرویک

مجله صفرویک